Sketch2Code

功能介绍

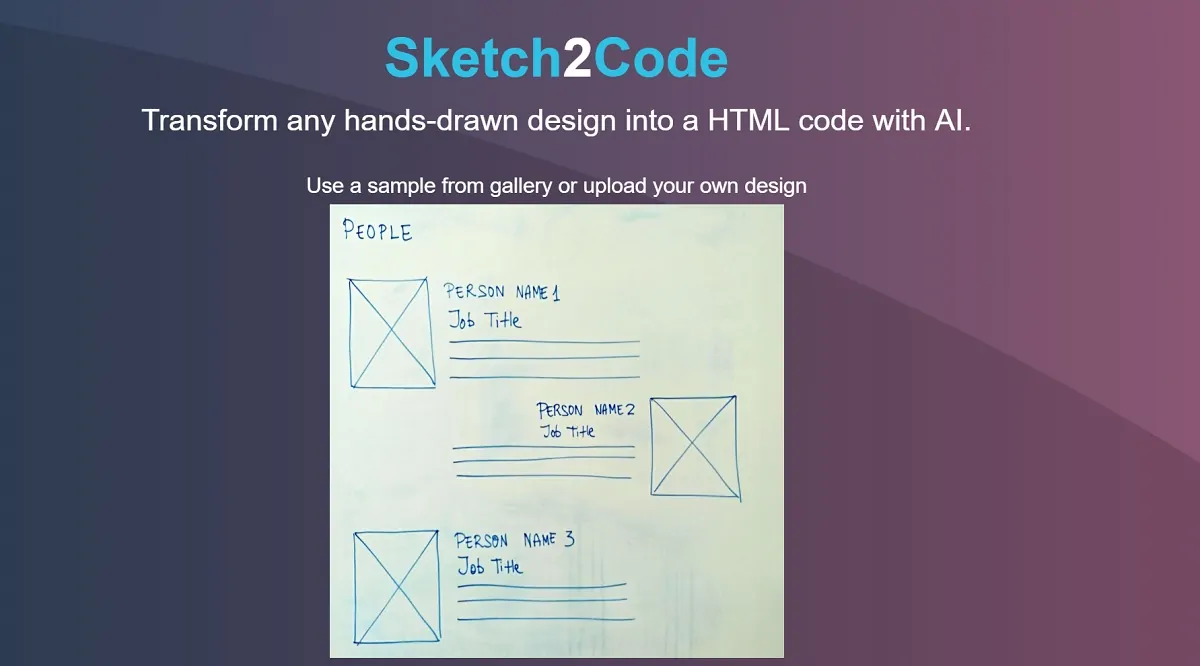

Sketch2Code是由微软AI实验室开发的一款基于视觉语言模型(VLMs)的AI工具,其核心功能是将手绘用户界面(UI)草图或线框图自动转换为可执行的HTML代码。用户可通过上传图像文件或直接绘制草图,触发AI模型对设计元素(如按钮、输入框、布局结构等)进行识别与解析,最终生成符合Web标准的前端代码。该工具支持文本识别功能,可提取草图中的文字内容并嵌入代码中,同时提供交互式调整选项以优化生成结果。

技术特点与架构

Sketch2Code的核心技术基于深度学习与多模态模型,其架构结合了计算机视觉与自然语言处理能力:

1. 视觉解析模块:采用卷积神经网络(CNN)对草图中的图形元素进行定位和分类,识别布局结构(如栅格、卡片式设计)及组件类型(如按钮、表单)。

2. 语义理解模块:通过预训练的视觉语言模型(如VIT或BERT的变体)将视觉特征与文本标注(如按钮上的文字)关联,确保生成的代码逻辑与设计意图一致。

3. 代码生成引擎:基于规则与机器学习结合的策略,将解析后的结构转化为HTML/CSS代码。例如,通过序列到序列(Seq2Seq)模型将组件层级映射为嵌套标签。

据arXiv论文《Sketch2Code: Evaluating Vision-Language Models for Interactive Web Design Prototyping》显示,该工具在测试中对复杂布局的识别准确率超过75%,但对非标准组件或模糊草图仍存在挑战,需依赖用户进一步调整。

发展历程与版本迭代

- 2018年:微软AI实验室启动项目,探索将草图自动化转代码的可行性。

- 2019年:首个原型系统内部测试,支持基础布局生成。

- 2020年:开源首个版本于GitHub(@Microsoft/AI Lab),引发开发者社区广泛关注,部分用户反馈生成代码需人工修正。

- 2022年:发布v2.0版本,新增对响应式设计的支持,并优化了文本识别模块。

- 2023年:引入用户界面反馈循环功能,允许通过自然语言指令微调生成结果(如“调整按钮间距至20px”)。

应用场景与市场影响

Sketch2Code在以下场景中显著提升效率:

- 前端开发:设计师可快速将草图转化为可交互原型,减少开发人员重复切图工作。例如,某电商公司使用该工具将原型开发周期缩短40%(据CSDN案例分享)。

- 教育与原型设计:学生或独立开发者无需编码即可验证设计概念,降低Web开发门槛。

- 跨团队协作:通过自动生成代码片段,UI设计师与工程师的沟通成本大幅降低。

然而,其市场影响也引发争议:部分前端开发者担忧工具可能替代基础代码编写工作(如CSDN评论中“切图仔瑟瑟发抖”的调侃),但业界普遍认为该工具更倾向于辅助而非取代人类,尤其在复杂交互逻辑实现方面仍需人工介入。

技术局限与未来展望

当前版本的Sketch2Code存在以下限制:

- 设计复杂度限制:对动态效果(如动画)、复杂交互(如表单验证)的支持有限。

- 依赖高质量输入:手绘草图若存在模糊或非标准符号,可能导致解析错误。

未来发展方向可能包括:

1. 多框架兼容性扩展:支持React、Vue等现代前端框架的代码输出。

2. 实时协作功能:集成云端协作平台,允许多人共同编辑生成的原型。

3. AI辅助调试:结合代码纠错模型,自动修复语法或兼容性问题。

重要贡献与开源生态

Sketch2Code的开源代码与文档(GitHub:[Microsoft/AI Lab/Sketch2Code](https://github.com/Microsoft/ailab))为研究者提供了重要的实验基准,推动了视觉编程领域的技术演进。微软团队通过持续迭代,逐步完善模型的鲁棒性与易用性,其技术路线为后续类似工具(如Adobe的Firefly设计生成器)奠定了基础。

参考资料:

- arXiv论文《Sketch2Code: Evaluating Vision-Language Models for Interactive Web Design Prototyping》

- 微软GitHub开源项目说明

- CSDN技术社区用户案例与讨论(2020-2023)

应用截图

2. 本站积分货币获取途径以及用途的解读,想在本站混的好,请务必认真阅读!

3. 本站强烈打击盗版/破解等有损他人权益和违法作为,请各位会员支持正版!

4. AI编程助手 > Sketch2Code